Blog de Mauricio Arancibia G., destinado a compartir información y experiencias con temas relacionado con la calidad. Six-sigma, Lean, ISO 9000, QAQC, teoría y práctica del Muestreo de P. Gy, estadística aplicados a la industria.

Todos los artículos publicados aquí pertenecen a mi autoría, salvo que se indique que es un artículo extraído de otras fuentes.

Para contactar escribir a mauricio.arancibia.g@gmail.com

sábado, 7 de septiembre de 2024

CÓMO APLICAR LA TEORÍA DE PIERRE GY EN LA PRÁCTICA

sábado, 24 de agosto de 2024

TRANSFORMACIÓN DE BOX-COX CON EXCEL

Una vez realizado todos estos cálculos se procede a usar la función SOLVER de Excel

Datos < Solver

Aquí de lo que se trata es minimizar el valor de sigma cambiando el valor de lambda, sujeto a la restricción de que lambda no puede ser mayor que 1.

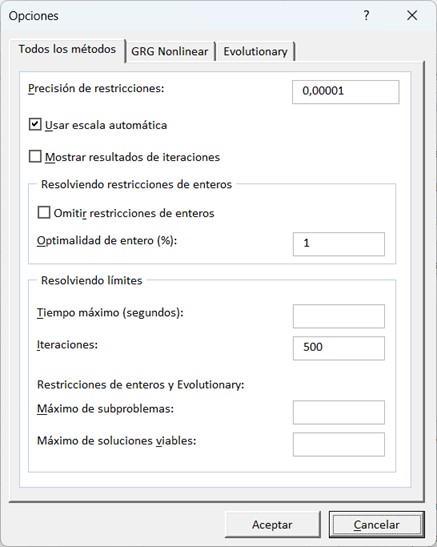

Las siguientes figuras muestran como completar los cuadros de diálogo para obtener el lambda que buscamos.

Colocando las siguientes restricciones

Aceptar, y en opciones colocar 500 iteraciones.

aceptar

Y finalmente, aceptar.

El resultado de lambda final para este ejemplo es 0,44. Como l = 0,44 está más próximo a l = 0,5. Por lo tanto, la transformación que procede es

jueves, 21 de marzo de 2024

ENSAYO SOBRE UNA NUEVA PROPUESTA DE MEDICIÓN DE LA VARIABILIDAD E INCERTIDUMBRE

Ronald Fisher fue quien se dio cuenta que había que diferenciar entre población y muestra. Fue él, precisamente, quien introdujo los términos de parámetros (asociados a la población) y estadísticos (asociados a la muestra). A la vez, también se percató que los parámetros desconocidos, teníamos que "estimarlos" a partir de una muestra, proceso denominado "inferencia estadística".

Hasta aquí, tenemos una población con parámetros desconocidos, donde la estimación de los parámetros se hace a través de una muestra, cuyos términos a evaluar se denominan ahora "estadísticos". Y la inferencia estadística se denomina al proceso mediante el cual se hace afirmaciones válidas acerca de la población o proceso con base en la información contenida en una muestra.

Sin embargo, algo que no nos dicen los libros de estadística clásico o introductorio, la mayoría al menos, es que para poder estimar el valor del parámetro a partir de una muestra, debemos necesariamente realizar "MEDICIONES" sobre esta última. Y la inclusión de este nuevo factor en la estimación del parámetro, lo cambia todo, porque necesariamente se tiene que incorporar nuevas fuentes de ruido que hacen que la estimación se haga menos precisa.

De eso se trata este artículo, de identificar cuáles son esas fuentes de variaciones e incertidumbres que se nos presentan en la minería y la industria para que podamos medirlas de la forma más óptima posible.

ESTIMACIÓN DE LOS PARÁMETROS DE UNA POBLACIÓN EN AUSENCIA DE SESGO

En este primer apartado, vamos a tratar de la estimación de los parámetros, media y variación natural de la característica de interés, de una población, estática o dinámica (proceso). Y esta estimación la vamos a realizar en ausencia de sesgo para facilitar nuestro análisis del modelo.

Por lo tanto, la secuencia para realizar una estimación del parámetro en el mundo real es:

POBLACIÓN - Muestreo - MUESTRA - Medición - RESULTADO

La siguiente figura corresponde a un modelo, todavía en calidad de borrador, que muestra tentativamente los factores involucrados en la estimación de parámetros de una población a través de una muestra. Lo que interesa aquí es estimar tanto la media como la variación de la característica en esa población.

Ojo con esta clasificación. La incertidumbre sólo se aplica a la segunda fila, es decir, sólo a la estimación de la variación natural de la característica de interés en el muestreo y en el sistema de medición. En cambio, el error estándar de la media no debería formar parte de ésta, porque se debería entender, en base a este modelo, que la incertidumbre corresponde a la semi - proporción o a la mitad del intervalo de tolerancia estadístico, que debería ser expresado con un intervalo de confianza dado, Intervalo que debería ser mucho más pequeño, insignificante, comparado con el intervalo de tolerancia dado para que la estimación tenga sentido práctico. Cuando el intervalo de confianza no cumple con esta condición, entonces, y sólo entonces, este intervalo debería sumarse al del intervalo de tolerancia estadístico.

En esta figura, se presenta la estimación de la variación natural de la característica de la población considerando todas las etapas hasta obtener un resultado. Como se puede apreciar, en el proceso de muestreo se introduce una variación adicional que corresponde a la variación natural del muestreo. Sin embargo, en el proceso de medición se vuelve a introducir una nueva variación, que corresponde a la variación natural del sistema de medición.

En todas estas etapas se han introducido variaciones que he denominado "natural" para diferenciarla de un cuarto componente, que no corresponde a la variación natural de las etapas anteriores, que es la que se asocia a la estimación del parámetro a través de un estadístico, en este caso, la desviación estándar de la media (error estándar de la media).

Diferenciar entre variación natural y variación para la estimación del parámetro es importante por varias razones.

- Las variaciones naturales son constantes a estimar, no dependen del tamaño de muestra. En cambio, la variación debido a la estimación del parámetro (error estándar de la media) depende fuertemente del tamaño de muestra.

- La variación para la estimación de la media poblacional sólo nos dice que tan confiables es el resultado obtenido. En cambio, la variación natural está asociada con la variabilidad de los procesos.

- De la variación natural de los valores originales (de la característica de interés) de la población o proceso

- De la variación natural (de la característica de interés) en el muestreo (incertidumbre del muestreo)

- De la variación natural (de la característica de interés) en el sistema de medición (incertidumbre del sistema de medición)

- Si queremos que nuestra estimación de la media y de la variación natural de la característica de interés en nuestra población o proceso originales sea lo más precisa posible, entonces debemos minimizar las variaciones 2 y 3.

- Si solo estamos interesados en estimar la variación o incertidumbre de la característica de interés introducida por el muestreo, entonces 1 y 3 deberán ser insignificantes,

- Y cuando nuestro objetivo, o nuestra población sea estimar la variación o incertidumbre de la característica de interés del sistema de medición, entonces, 1 y 2 deberán ser insignificantes.

- Sin embargo, si nuestro interés es estimar la variación de la característica de interés del muestreo más la del sistema de medición, entonces sólo 1 deberá ser insignificante o cero.

NO CONFUNDAS INTERVALOS DE CONFIANZA CON INTERVALOS DE TOLERANCIA ESTADÍSTICO

- Meeker, Hans, Escobar - Statistical Intervals_ A Guide for Practitioners and Researchers - Ed. 2017

- Montgomery, Runger - Applied Statistics and Probability for Engineers, - 7ª Ed, 2018

- Walpole, Myers, Myers, Ye - Probability & Statistics for Engineers & Scientists - Ed. 2016

- Norma ISO 16269-6:2014 - Statistical interpretation of data — Part 6: Determination of statistical tolerance intervals - Ed 2014

sábado, 10 de febrero de 2024

ESTADÍSTICA DE DUPLICADOS PARA EL CONTROL DE CALIDAD DE MUESTRAS GEOQUÍMICAS

El presente artículo tiene por objeto mostrar la estadística que actualmente se usa en el tratamiento de los datos en muestras geoquímicas para determinar la precisión en condiciones de repetibilidad o reproducibilidad en base sólo a muestras duplicadas.

Algunos de los estadísticos más comunes que aparecen en este control, son, la media aritmética, la desviación estándar, el rango, el error relativo, el coeficiente de variación y la varianza relativa.

La siguiente tabla presenta un resumen de estos estadísticos en base sólo a pares de duplicados:

Nota (1). - X1 es el dato original y X2 es el dato duplicado.El error sistemático, es aquel error en donde los valores de las observaciones tienden a ser persistentemente más altos que la media esperada o persistentemente menor que esta. Las causas pueden ser variadas, como un equipo descalibrado, un material de referencia no válido, un método analítico no adecuado, temperaturas no controladas, etc. Este error puede ser corregido.

El error aleatorio, en cambio, es aquel error donde los resultados individuales caen a ambos lados de la media, regidos sólo por el azar, de acuerdo con un tipo de distribución. Este error puede ser mejorado, pero nunca cancelado, ya que está asociado a las limitantes propias de cada proceso.

Por último, el "error grueso" o "error grosero" es aquel que está asociado a los errores personales, a las equivocaciones, tales como una mala transcripción de los datos, un intercambio de muestras, errores de tipeo, etc. Es decir, errores que son ajenos a la población o al proceso mismo. Estos errores se deben identificar, investigar sus causas y evitar su recurrencia a través de un sistema de calidad preventiva. Este error puede ser minimizado si se cuenta con un buen sistema de calidad.

Por lo tanto, con estos antecedentes, el objetivo de cualquier sistema de control de calidad es la de identificar estos tipos de errores y corregirlos y/o minimizarlos según corresponda.

A continuación, se presentan algunas herramientas de control que pueden ser útiles en la detección y corrección principalmente de este tipo de errores, pero que están asociados principalmente a la estadística de los pares de duplicados.

a) Análisis de la dispersión de duplicados

Los pares de datos, original y duplicado pueden ser analizados mediante un gráfico de dispersión, donde en el eje de la ordenada se coloca el valor duplicado y en el eje de la absisa, el valor original.

Estos valores se plotean en este tipo de gráfico, y se traza una línea 1:1, de 45 grados respecto a la horizontal con el fin de visualizar si existen ciertos patrones que puedan caracterizar el conjunto de los datos, como, por ejemplo, verificar el tipo y magnitud de la dispersión respecto a lo esperado, presencia de error sistemático y/o presencia datos anómalos (outliers).

Una desventaja de este gráfico, si se usan los límites de control tal cual se muestra en la figura, es que los valores de aquellas muestras con concentraciones cerca del límite de detección van a tender a ser rechazadas en circunstancias que pueden ser muestras completamente válidas. Para evitar esto último, se recomienda usar líneas de control de función hiperbólicas (Ver método hiperbólico).

b) Gráfico MIN-MAX

Este gráfico considera en el eje de la absisa colocar el valor mínimo y en el eje de las ordenadas el valor máximo correspondientes a un par de duplicados.

- En Excel, disponer de los pares de resultados, por ejemplo, en una columna A el original y en una columna B el duplicado.

- En una columna C, calcular el máximo por cada par de resultados

- En otra columna D, calcular el mínimo por cada par de resultados

- Plotear en un gráfico los valores máximos versus el mínimo

- Considerar una recta 1:1 de 45°

c) Gráfico hiperbólico

Este método considera que, a bajas concentraciones, es altamente probable que muchas observaciones de muestras completamente válidas con el gráfico anterior pueden quedar fuera de los límites de control, debido a que a bajas concentraciones la dispersión de los resultados tiende a aumentar. Para evitar este problema, se construye este gráfico en la que el límite de control obedece a una función hiperbólica de la forma y2 = x2m2 + b2, donde m es la pendiente, x es el valor mínimo de la observación y b el intercepto.

Para construir esta relación en un gráfico, se debe estimar la diferencia relativa absoluta de los pares de duplicados y graficarlo en función del porcentaje acumulado como sigue:

- Calcular el error relativo (diferencia relativa absoluta) para cada par de duplicados y colocarlo en una columna de Excel

- Ordenar el error relativo de menor a mayor

- En otra columna calcular el porcentaje de datos acumulados según la posición que tiene el error relativo.

- Plotear en un gráfico el error relativo, en porcentaje versus el % de datos acumulados

- Evaluar el desempeño de los datos duplicados en base al criterio previamente establecido para los diferentes tipos de duplicados.

Otro de los gráficos que pueden ser útiles para ver el comportamiento de los datos es el de la diferencia relativa versus la ley promedio del elemento de interés.

f) Análisis de la precisión de Howarth-Thompson

Este método, al igual que los gráficos de dispersión anteriores tiene por objeto establecer límites de control para rechazar aquellas observaciones (y muestras) que son inconsistentes con lo que se espera en el proceso. Estas muestras deberían ser nuevamente chequeadas en el laboratorio.

Para la construcción de este gráfico de control, la curva se obtiene a partir de datos históricos, donde el CV (Precisión de HT) se plotea en función de la concentración media.

El Control de calidad se puede efectuar en base al estadístico muestral ARD o HARD, que es representado por cada punto en el gráfico. Si El ARD o HARD, según corresponda es mayor al límite de la curva, entonces esa muestra se rechaza.

Nota. - Para más información sobre este estadístico, ver mi otro post:

Estimación de la precisión mediante el estadístico de Howarth-Thompson

Cuantificación de la precisión

Para estimar la precisión de las diferentes etapas del proceso se deben tener en consideración las siguientes observaciones:

- La precisión del proceso sólo tiene sentido si el proceso es estable y si está libre de observaciones anómalas que no pertenecen al proceso mismo. En otras palabras, está asociada al error aleatorio. Por lo tanto, es importante que para estimar la precisión deben eliminarse aquellos outliers, que no forman parte del proceso.

- La precisión es función de la concentración. A medida que la concentración disminuye, el CV tiende a ser más grande. Por lo tanto, se recomienda para cuantificar y comparar la precisión a través del tiempo, hacerlo no sólo de una manera global, sino por rangos de concentración adecuados.

- Si se quiere estimar la precisión de los duplicados de preparación, deberá entenderse que la precisión así obtenida en el laboratorio corresponde a la suma de la precisión de la preparación y del análisis. Por lo que para obtener la precisión sólo de la preparación de muestras, la precisión total deberá restarse a la precisión del análisis.

- Si se quiere estimar la precisión de los duplicados de terreno, deberá entenderse que la precisión así obtenida en el laboratorio corresponde a la suma de la precisión del muestreo, de la preparación y del análisis. Por lo que para obtener la precisión sólo del muestreo, la precisión total deberá restarse a la precisión de la preparación y del análisis.

- Hay dos formas de restar estas precisiones a la precisión total para obtener las precisiones de preparación y de terreno, a) haciéndolo de una manera aproximada, considerando una estimación media del análisis y preparación en el mes por ejemplo y b) considerando un modelo anidado de acuerdo con la siguiente figura. Aquí la forma de generar los duplicados de preparación es hacerlo sobre los duplicados de terreno ya existentes, y para generar los duplicados de análisis hacerlo sobre los duplicados a la vez de preparación ya existente

Referencias

- Abzalov M – Applied Mining Geology-Springer International Publishing – Ed. 2016.

- MRDI - Assay Quality Assurance Quality Control Program for drilling projects at the pre-feasibility report level – 3°Ed.2000

- Thompson M, Howarth R. -Duplicate Analysis in Geochemical Practice. Part 1. Theoretical Approach and Estimation of Analytical Reproducibility. Ed 1976.

- ISO 12744:2006 - Copper, lead, zinc and nickel concentrates — Experimental methods for checking the precision of sampling

- Curso-Taller de Tratamiento de datos con Excel para Control de calidad aplicado a procesos mineros de Mauricio Arancibia G.

martes, 6 de febrero de 2024

CARTAS DE CONTROL DE SHEWART PARA VALORES INDIVIDUALES EN EXCEL

Se denominan

"por variables" cuando las medidas pueden adoptar un intervalo

continuo de valores; por ejemplo, la longitud, el peso, la concentración, etc.

Se denomina "por atributos" cuando las medidas adoptadas no son

continuas; ejemplo, tres tornillos defectuosos cada cien, 3 paradas en un mes

en la fábrica, seis personas cada 300, etc.

Antes de

utilizar las cartas de control de valores individuales por variables, debe tenerse en consideración

lo siguiente:

- Los datos deben ser continuos

- Los datos deben estar en orden cronológico

- Los datos se deben recolectar en intervalos de tiempo igualmente espaciados

- Los datos deben ser observaciones individuales que no se recolectan en subgrupo

- Los datos deben incluir al menos 100 observaciones totales

- Los datos deben ajustarse a una distribución normal o aproximadamente normal

- Las observaciones no deben estar correlacionadas entre sí

Las etapas que deben tomarse en cuenta para mejorar el proceso están esquematizadas en la siguiente figura:

Cartas de control de valores individuales por variables sin especificación en Excel

Si las cartas no usan especificaciones, entonces se puede usar la media aritmética y la desviación estándar del mismo proceso.

A continuación, se presenta la forma como se pueden construir estas cartas en Excel

El siguiente ejemplo utiliza 50 datos de contenido de hierro, expresado en porcentaje, que corresponde a los valores obtenidos de un material de referencia ensayado en un laboratorio en particular:

Datos:

Cálculos en Excel:

Con estos datos, podemos construir las cartas de control respectivas.

- ISO 7870-2:2023 Control charts - Part 2: Shewhart control charts

- Alwan L. - Statistical Process Analysis - Ed. 2000

- Minitab 21 referencia

- Curso de Control de calidad con Excel de Mauricio Arancibia G. - Ed. 2023